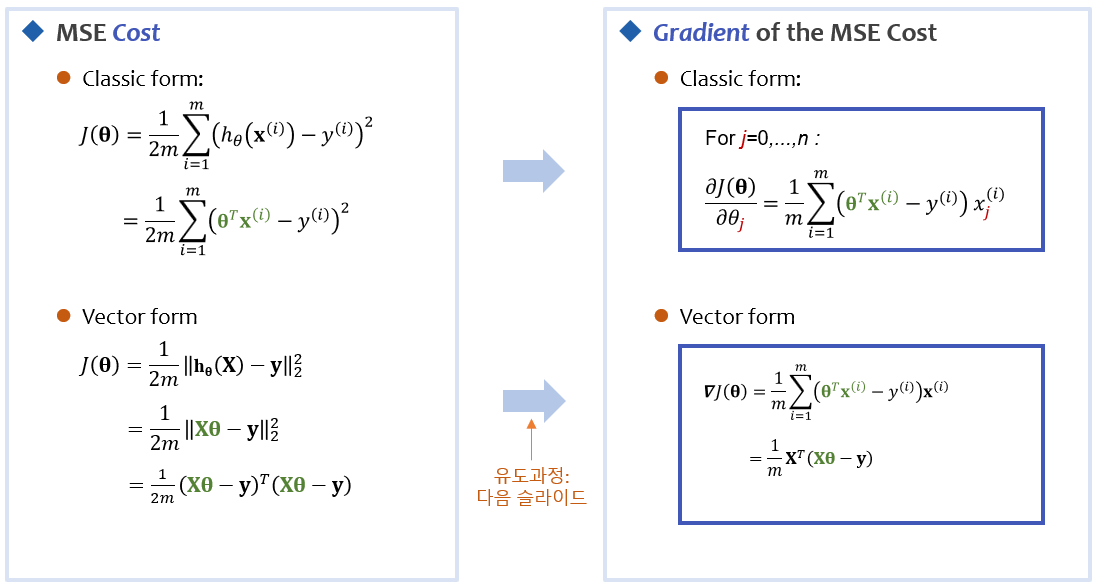

MSE cost

Linear regression에서의 MSE cost와 그 gradient는 다음과 같다.

다음은 그 유도 과정이다.

Normal Equations

아래와 같이 gradient 수식을 통해 가중치 값을 바로 구해낼 수 있다.

이 경우 gradient descent로 가중치를 지속적으로 업데이트 해줄 필요 없이 바로 최종 가중치 값을 얻어낼 수 있지만 inverse 계산이 필요하기 때문에 특성이 많아지면 오히려 속도가 느릴 수 있다.

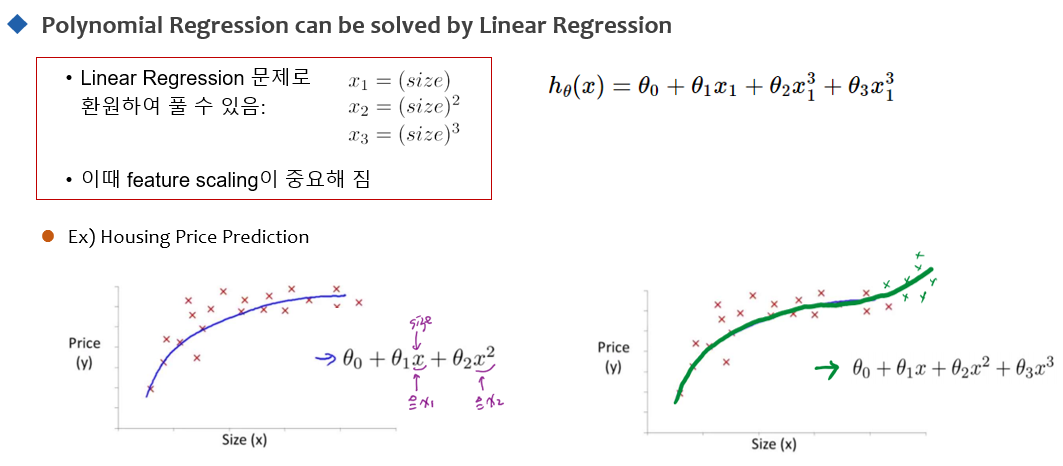

Polynominal Regression

고차항을 변수로 치환하여 Linear regression 문제로 환원하여 풀 수 있다.

Feature Normalization

feature 간 스케일이 다를 경우 cost function이 스케일이 큰 feature의 경향을 더 많이 받을 수 있다. 때문에 feature 간의 스케일을 같게 맞춰주는 작업이 필요하다.

Learning rate

Learning rate이 너무 클 경우에는 오히려 발산해서 답이 나오지 않을 수도 있고, 너무 작을 경우 수렴이 느려지거나 local minimum에 수렴할 수 있다. 이 때문에 적절한 learning rate을 설정하는 것이 중요하다.

'학교공부 > 기계학습' 카테고리의 다른 글

| [기계학습] 가중치 감쇠 (1) | 2023.10.23 |

|---|---|

| [기계학습] 각 모델들의 Cost function과 Gradient (0) | 2023.10.21 |